Gebruik van ongeteste AI-content door extreem-rechtse partijen

Naar aanleiding van de Europese verkiezingen in 2024, die plaatsvonden in juni, maakten meerdere extreem-rechtse politieke partijen in onder andere Frankrijk, Italië en België gebruik van niet-gelabelde, door AI gegenereerde inhoud om kiezers te beïnvloeden. Dit terwijl ze eerder beloofd hadden zich aan ethische campagnestrategieën te houden.

In de weken voorafgaand aan het stemmen identificeerden onderzoeksgroepen zoals DFRLab, Alliance4Europe en AI Forensics in totaal 131 stukken content die door AI waren gemaakt of gemanipuleerd, zonder dat dit duidelijk werd gemaakt. Deze inhoud circuleerde via kanalen als Instagram, Facebook, X, Telegram en Vkontakte.

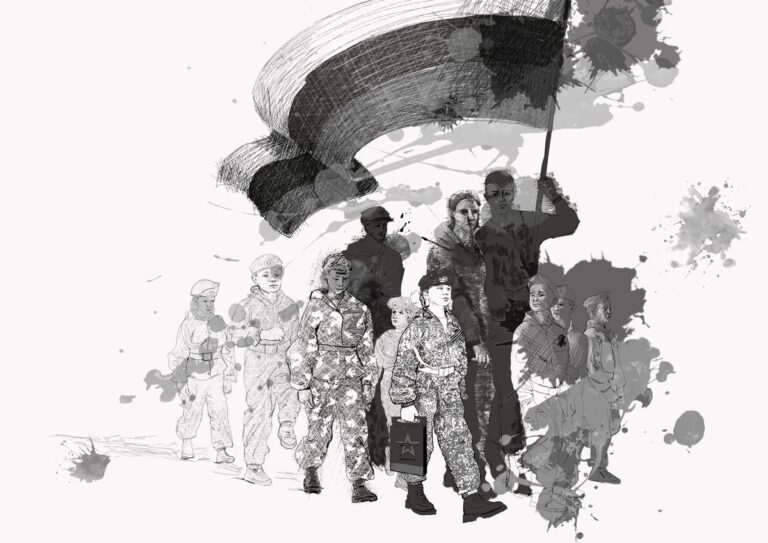

De gevonden materiaalvariëteit liep van valse afbeeldingen en door AI verbeterde visuals tot shallowfakes en goedkope manipulaties, waarbij weinig kostende methoden werden gebruikt, zoals misleidende onderschriften gekoppeld aan foutieve beelden. Deze content had als doel de sociale scheidslijnen te versterken, samenzweringstheorieën te verspreiden en het publieke debat te verstoren.

De rol van de Europese Unie en de detectie van manipulatieve inhoud

De eigen post-verkiezingsrapporten van de Europese Commissie bevestigden dat deze patronen bestonden. Volgens het rapport maakten politieke actoren gebruik van dergelijke niet-gelabelde materiaal om misleidende narratieven te verspreiden en sociale verdeeldheid te vergroten. Een groot aantal van de geconstateerde gevallen betrof content gedeeld door politieke partijen, vooral in Frankrijk, België en Italië.

In tegenstelling tot de vrees voor complexe deepfakes bleken de meeste manipulaties eenvoudig, goedkoop en gericht. Voorbeelden omvatten korte, foutieve onderschriften, gefabriceerde scènes over migratie en door AI verbeterde afbeeldingen die islamofobe verhalen ondersteunden, zoals de zogeheten “Moslim Grote Vervanging”.

Electorale gevolgen en de betrokkenheid van parlementsleden

De praktische gevolgen van deze praktijken blijken uit de situatie in het Europees parlement. Van de 37 europarlementariërs die tijdens de verkiezingen werden gekozen, behoren er 29 tot Rassemblement National, acht tot Lega en één tot Reconquête, partijen waarvan bekend is dat zij AI-gegenereerde of gemanipuleerde content hebben gebruikt tijdens de campagne.

Verschillende van deze gekozen vertegenwoordigers zitten nu in commissies, waaronder LIBE, IMCO en de nieuwe Democratie Schild commissie, die zich bezighouden met de aanpak van desinformatie, digitale regelgeving en artificiële intelligentie. Dit leidt tot een paradox: degenen die regels maken om manipulatie te voorkomen, werden zelf mogelijk beïnvloed door technieken die ze nu willen reguleren.

Het gebrek aan adequate regelgeving en de rol van politieke partijen

Het EU-beleid erkent dat het strijdt tegen disinformatie, maar de regelgeving bevat geen mechanisme om politieke actoren te sanctioneren voor het gebruik van niet-gelabelde AI-content. Het Europese Code of Conduct voor verkiezingen uit 2024, ondertekend door alle politieke families waaronder het extreem-rechtse Gezelschap Identiteit en Democratie (ID), biedt slechts een informatief kader.

Na de verkiezingen werd ID ontbonden en hernoemd tot Patriots for Europe (PfE), zonder de toezeggingen van ID over het verantwoord gebruik van dergelijke technieken. De Europese regelgeving richt zich vooral op platformen zoals grote online platformen en zoekmachines, niet op de politieke partijen die desinformatie verspreiden.

Onderzoek en zorgen over de toename van manipulatie

Volgens onderzoekers zoals Valentin Châtelet kan de code slechts onderzoeken op basis van het Digital Services Act (DSA), maar dat reguleert vooral digitale platformen, niet de politieke groepen zelf. Bovendien blijven aanbevelingen gericht op platformen, terwijl de politieke actoren die deze middelen gebruiken, vrijwel niet worden aangepakt.

In de praktijk blijkt dat de EU vooral probeert het probleem te beperken tot infrastructuur, zonder werkelijk de verantwoordelijken aan te pakken. Onderzoek waarschuwt dat wanneer campagnes digitaal worden, manipulatieve tactieken steeds routineuzer worden.

Voorbeelden van verdere impact worden zichtbaar in andere landen zoals Ierland, Tsjechië en Nederland. In Ierland circuleerde een valse uitzending waarin aangekondigd werd dat een presidentskandidaat zich had teruggetrokken, terwijl in Tsjechië een nieuwe golf AI-gemanipuleerde content over migratie, criminaliteit en EU-lidmaatschap werd vastgesteld. Nederlandse autoriteiten waarschuwden voor AI-gestuurde manipulatie, waaronder misleidende chatbots en algoritmische vooroordelen die de geïnformeerde stemkeuze kunnen ondermijnen.

De onvolmaakte reactie en de bredere Europese risico’s

Tot nu toe heeft de reactie van de EU op deze fenomenen zich beperkt tot algemene waarschuwingen, zonder bindende maatregelen of sancties. Een enkele uitzondering is het annuleren van de presidentsverkiezing in Roemenië in 2024, vanwege desinformatie.

De incidenten illustreren een bredere dreiging voor de Europese democratie. Het dilemma ligt in de verantwoordelijkheid voor het reguleren van deze technologieën deels bij de parlementariërs die zelf deels dankzij deze tactieken zijn gekozen. Brussel’s wetgevers die via vergelijkbare tools hun zetels verkregen, stellen nu de regels op die hen mogelijk zelf kunnen treffen.

De fundamentele vraag hierbij is hoe de EU geloofwaardig AI en desinformatie kan reguleren terwijl haar eigen volksvertegenwoordigers al gebruik maakten van ongecodeerde generatieve AI tijdens de campagnes.